一、AI框架的重要性

AI框架是人工智能的操作系统,是基础软件,是算法和应用的根基。AI江湖传言:得框架者得天下,可见AI框架的重要性,它通过框架性思维整合了人工智能的三驾马车(算法、算力、数据),如果想成为头部AI企业,AI框架就是其中一项核心竞争力,这样才不会受制于人,才能体现AI基础研究能力,这也是为什么AI公司争相研发自己的AI框架。AI框架好比武林绝学中的上乘内功,任何武功招式,没有内功加持,最终也只是花拳绣腿,高手最终的比拼就是内功。

谈AI框架,不得不提到一个国家,一座山,一个小镇、一种酒、一个研究所,那就是瑞士、阿尔卑斯山、马蒂尼、葡萄酒、戴尔莫尔感知人工智能研究所。正是在这样一个环境优美,生活惬意的地方,可能是做学术最好的环境,自由和灵感在这里悄无声息地碰撞,这里的研究所是全球人工智能和认知智能领域的领导者之一,最初的Torch框架就诞生于此,由此开启了AI框架研究的热潮。

我们正处于AI时代浪潮中,不能重走明清海禁和闭关锁国之路,应当与世界同步,吸收和创新发展AI,这样才不至于在科技竞争中落败。网络安全也离不开AI,不管是AI自身面临的安全问题,还是利用AI去解决网络安全问题,作为网络安全从业者,都应当主动拥抱AI,思考AI和网络安全的关系,如何解决矛和盾的问题。下面主要介绍AI框架的发展历程、主流AI框架及AI框架的安全问题。

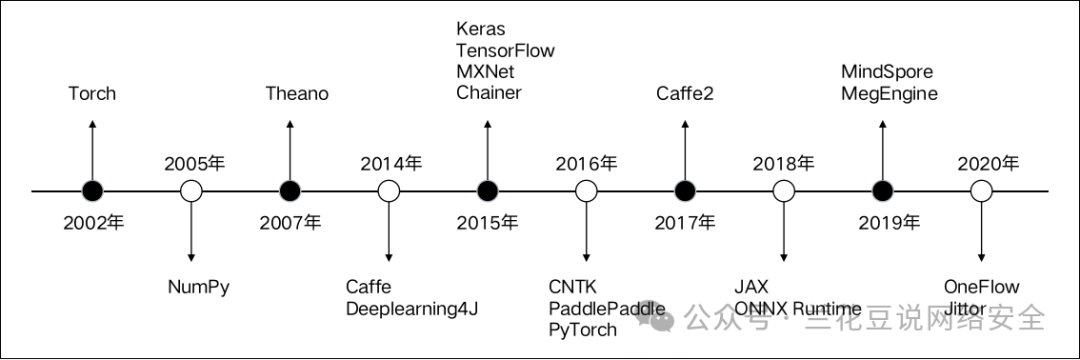

二、AI框架的发展历程

道德经中说:“道生一、一生二、二生三、三生万物,”从零到一的过程是艰难的,那是思维的创新,是意识的萌芽,正如Torch的中文翻译,是第一颗火种,开创了AI框架的先河,由此AI框架的发展一路风风火火,下面通过时间线来描述AI框架的发展历程。

三、主流AI框架介绍

1.Torch

Torch是由Ronan Collobert、Clement Farabet等于2002年推出的科学计算框架,提供了强大的张量计算和深度学习支持。原始Torch是Lua语言的,而后续的Torch7版本则支持LuaJIT。Torch在深度学习领域广受欢迎,为研究和实际应用提供了灵活性和效率,尤其在神经网络的研究和开发中取得了成功。然而,后来由于竞争对手的兴起,如PyTorch和TensorFlow,Torch逐渐被这些框架取代。

2.NumPy

NumPy是由Travis Olliphant于2005年发布的开源数值计算库,用于Python编程语言。它提供了强大的多维数组对象和对这些数组执行操作的工具,是科学计算、机器学习等领域的基础。NumPy的设计目标是提供高性能的数组操作,使得数据处理和分析更加高效。它的成功促成了许多其他科学计算和数据分析工具的发展,如SciPy、Pandas和Scikit-learn。NumPy从严格意义上来说,它不是一个AI框架,而是一个重要的科学计算库,为后来者提供很多借鉴意义。

3.Theano

Theano是由蒙特利尔大学的MILA实验室于2007年发布的开源数学库,用于高效实现深度学习和科学计算,号称深度学习研究和开发的行业标准,是行业的祖师爷。主要作者包括Yoshua Bengio和Ian Goodfellow等。Theano支持符号数学表达式,自动优化GPU加速,为构建和训练神经网络提供了强大的工具。然而,由于TensorFlow和其他深度学习框架的崛起,Theano在2017年之后停止了主要开发。

4.Caffe

Caffe是由伯克利视觉与学习中心(BVLC)于2014年发布的开源深度学习框架,主要作者为贾扬清(Yangqing Jia)。以速度和灵活性为特点,Caffe被广泛用于计算机视觉任务。其模块化架构和易于配置的设计使其适用于各种深度学习应用,包括图像分类和目标检测。

5.Deeplearning4J

Deeplearning4J是由Skymind公司于2014年发布的开源深度学习框架,主要作者为Adam Gibson。基于Java语言,支持分布式计算,提供强大的工具和算法用于图像识别和自然语言处理。其注重性能和可扩展性,成为大规模数据集上训练复杂神经网络的重要工具。

6.Keras

Keras是由François Chollet于2015年3月发布的高级深度学习框架,最初建立在Theano上,后来集成到TensorFlow中。设计简单直观,提供用户友好的API,支持快速构建、训练和部署神经网络模型。Keras成为TensorFlow的官方高级API,广受欢迎,适用于各种深度学习任务。

7.TensorFlow

TensorFlow是由Google Brain团队开发的开源深度学习框架,于2015年11月发布。主要作者包括Jeff Dean、Rajat Monga等。TensorFlow提供强大的工具和库,支持构建和训练各种机器学习模型。其灵活性和可扩展性使其成为学术界和工业界首选的深度学习框架,广泛用于图像识别、自然语言处理等领域。

8.MXNet

MXNet是由华盛顿大学的李沐(Mu Li)等于2015年发布的深度学习框架。作为Apache软件基金会的项目,MXNet以高效性能和灵活性著称,支持动态计算图和多语言接口,广泛应用于云端和边缘设备。其分布式训练能力使其在计算机视觉和自然语言处理等领域得到广泛应用。AWS对MXNet表现出浓厚兴趣,并在其深度学习服务中广泛采用MXNet。因此,MXNet在AWS上得到了大量支持和推广,成为AWS深度学习服务的一部分。

9.Chainer

Chainer是由日本Preferred Networks公司于2015年发布的开源深度学习框架。主要作者为Seiya Tokui、Shunta Saito等。Chainer采用动态计算图的方式,提供灵活性和直观性,支持易于扩展的开发。其设计理念注重用户友好,适用于快速原型设计和实验。Chainer在日本及全球深度学习社区中取得成功,为研究人员和开发者提供了强大的工具。

10.CNTK

CNTK(Microsoft Cognitive Toolkit)是由Microsoft开发的开源深度学习框架,于2016年发布。主要作者包括Xuedong Huang等。CNTK专注于高性能和可扩展性,支持分布式训练和多种深度学习模型。其灵活性和优化使其在语音识别、图像处理等领域广泛应用。CNTK提供易用的Python接口,是微软在深度学习研究和工程方面的重要贡献。

11.PaddlePaddle(飞桨)

PaddlePaddle(飞桨)是由百度公司于2016年发布的开源深度学习框架。主要作者为百度深度学习研究院团队。PaddlePaddle注重产业应用,提供灵活性和高性能,支持深度学习任务,包括图像识别和自然语言处理。其特点包括易用性、可扩展性和丰富的模型库,适用于从研究到生产环境的多个场景。

12.PyTorch

PyTorch是由Facebook于2016年发布的开源深度学习框架。主要作者包括Adam Paszke、Sam Gross等。PyTorch采用动态计算图,强调易用性和灵活性,成为研究和实际应用的首选工具。其优雅的API和紧密集成的动态图机制促使其被广泛采用。PyTorch在自然语言处理、计算机视觉等领域取得成功,也是深度学习研究和开发中的重要框架。

13.Caffe2

Caffe2是由Facebook于2017年发布的开源深度学习框架。主要作者包括Yangqing Jia等。作为Caffe框架的进化版本,Caffe2专注于性能和可扩展性,支持多平台和分布式训练。它在计算机视觉、自然语言处理等领域得到广泛应用,同时被集成到PyTorch中,为深度学习社区提供了灵活性和效率。

14.JAX

JAX是由Google于2018年发布的开源数值计算库,旨在提供高性能的机器学习和科学计算。主要作者为研究员Matt Johnson和其他Google Brain团队成员。JAX支持自动微分、XLA编译器,以及numpy风格的API,使其成为构建灵活而高效的机器学习模型的理想工具。其在强化学习、深度学习研究和实际应用中得到广泛应用。

15.ONNX Runtime

ONNX Runtime是由微软于2018年开源的深度学习推理引擎。主要作者为微软的研究团队。ONNX Runtime支持ONNX(Open Neural Network Exchange)格式的模型,实现了高性能、跨平台的推理。它与各种深度学习框架兼容,包括TensorFlow、PyTorch等,为模型在不同平台上的部署提供了灵活性和效率。ONNX Runtime在机器学习社区中被广泛应用。

16.MindSpore( 昇思)

MindSpore是由华为于2019年发布的开源深度学习框架,旨在支持全场景的AI应用。主要作者为首席架构师金雪锋等。MindSpore采用计算图技术,提供易用的Python API和高性能的推理和训练支持。其灵活性、安全性和跨硬件的特点,使其适用于多种设备和应用场景,包括端侧智能、云端大模型训练等。

17.MegEngine(天元)

MegEngine是由旷视科技于2019年发布的开源深度学习框架。主要作者包括旷视科技的研究团队。MegEngine注重性能、灵活性和易用性,支持静态计算图和动态计算图,适用于多种深度学习任务。其设计优化了内存占用和计算效率,广泛应用于计算机视觉、自然语言处理等领域。

18.OneFlow(一流)

OneFlow是由北京一流科技有限公司开发的开源深度学习框架,由袁进辉创立。该框架于2020年左右发布,以解决大数据、大模型和大计算环境下的分布式扩展难题为核心目标,率先提出静态调度与流式执行概念,实现高性能并行计算。OneFlow兼容PyTorch接口,提供极致性能的分布式机器学习解决方案,并在AIGC等领域有显著应用表现。

19.Jittor(计图)

Jittor是由清华大学计算机系图形与媒体实验室研发的开源动态图深度学习框架,发布时间在2020年左右。该框架由清华大学科研团队设计与实现,以即时编译(Just-In-Time compilation)技术为核心,实现了灵活高效的模型构建和高性能执行。Jittor具备自动求导、元算子优化等特性,为用户提供了一个支持多种硬件平台且高度可扩展的深度学习开发环境,在深度学习研究领域展现出卓越性能与创新价值。

以上只列举了部分AI框架,对于初学者,建议从NumPy开始学习基础数学和数据处理,然后转向PyTorch,了解深度学习框架,逐步学习整个AI训练步骤。NumPy提供了强大的数学和数组操作,而PyTorch是一个灵活且易于学习的深度学习框架,有助于理解模型构建、训练和部署。这两者是建立深度学习理解的良好起点。

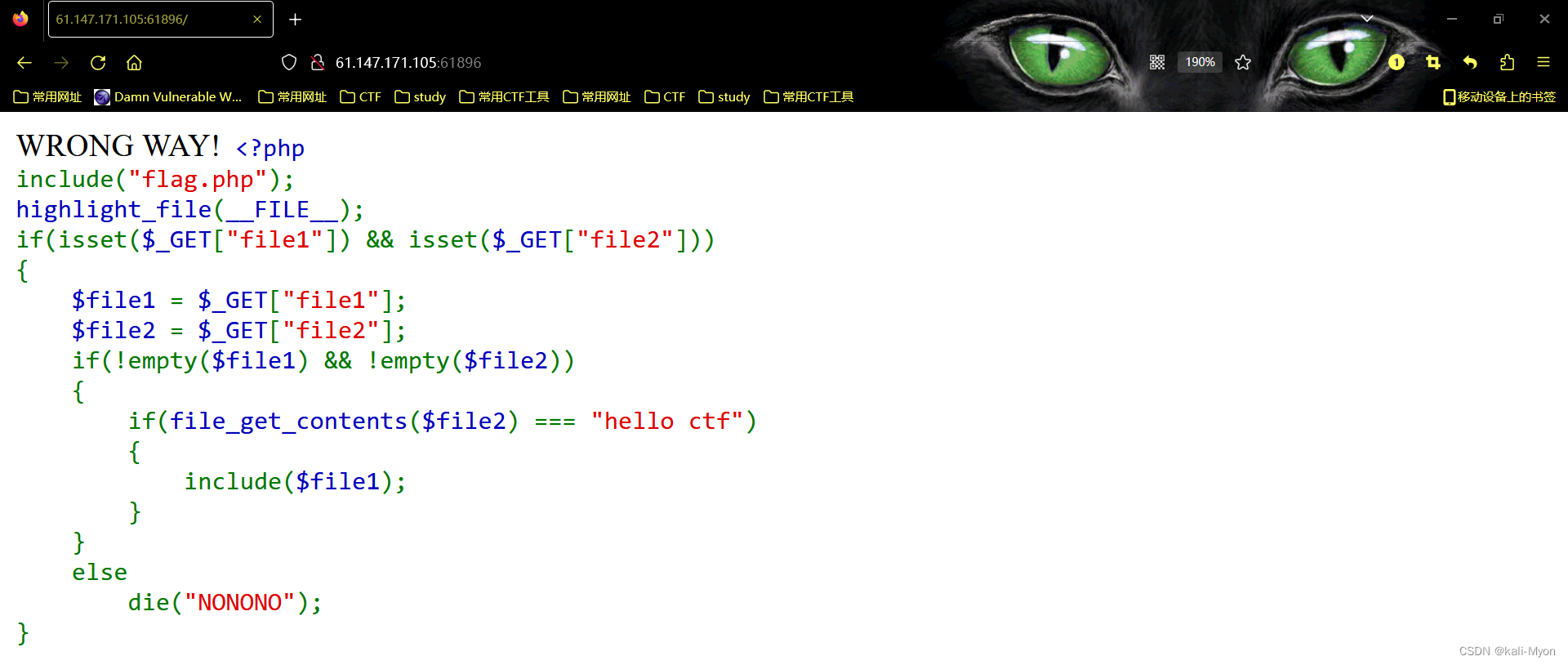

四、AI框架面临的安全问题

AI框架本身作为AI的操作系统,也面临一些安全问题,下面列举了一部分:

对抗性攻击:恶意用户可能通过微小的、经过精心设计的修改来欺骗AI模型,导致模型错误的分类或输出。对抗性攻击可能对图像分类、语音识别等应用造成潜在风险。

数据隐私:AI模型的训练依赖于大量的数据,包括敏感信息。不适当的数据处理和存储可能导致隐私泄露,特别是当模型被攻击者用于推断原始训练数据时。

模型解释性:对于一些领域,特别是涉及法规和伦理要求的情况,AI模型的解释性至关重要。缺乏对模型决策的理解可能引发信任和合规性问题。

后门攻击:恶意用户可能试图在训练过程中注入后门,使得模型在特定条件下产生错误的结果。这种问题可能出现在模型的训练数据或训练过程中。

模型盗窃:攻击者可能尝试盗取受保护的AI模型,从而减少开发人员的努力并绕过知识产权的保护。

不公平性和偏见:AI模型在训练中学到的偏见可能导致对某些群体的不公平对待。这可能引发社会和法规方面的问题。

模型更新和部署安全:安全地更新和部署模型是一个挑战,尤其是在生产环境中。不当的模型更新可能导致性能下降或潜在的安全漏洞。

解决这些问题需要综合考虑算法的鲁棒性、数据隐私保护、模型解释性、安全更新和合规性等方面。研究人员和开发者也正在不断努力提出新的技术和方法来应对这些挑战。

五、总结

作为网络安全从业人员,我们必须了解AI框架的基本原理和使用方法,这样才能更好地了解AI安全问题和借助AI解决网络安全问题。

发表评论 取消回复